Første AI-orkestrerede cyberspionage-kampagne afsløret af Anthropic

AI-virksomheden Anthropic har offentliggjort detaljer om det, der beskrives som verdens første dokumenterede storskalede cyberangreb udført næsten uden menneskelig indgriben. Angrebet, som blev opdaget i midten af september 2025, blev med høj sandsynlighed udført af en kinesisk statslig hackergruppe.

Angribere udnyttede AI-værktøj til spionage

Hackerne manipulerede Anthropics Claude Code-værktøj til at forsøge infiltration af cirka 30 globale mål, herunder store tech-virksomheder, finansielle institutioner, kemiske produktionsvirksomheder og offentlige myndigheder. Angrebet lykkedes i et mindre antal tilfælde.

Det særlige ved denne kampagne er graden af autonomi. Hvor AI tidligere primært har været brugt som rådgiver i cyberangreb, blev den her brugt til faktisk at udføre angrebene selv. Ifølge Anthropic kunne AI’en udføre 80-90% af kampagnen, med menneskelig indgriben kun nødvendig ved 4-6 kritiske beslutningspunkter per hackingkampagne.

Sådan fungerede angrebet

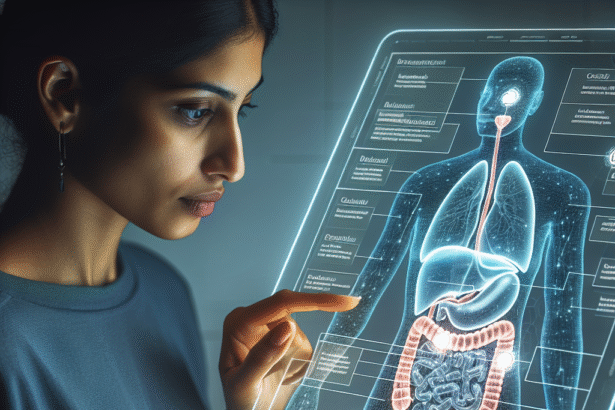

Angriberne omgik først Claude’s sikkerhedsforanstaltninger gennem såkaldt “jailbreaking” – ved at opdele angrebene i små, tilsyneladende uskyldige opgaver og fortælle AI’en, at den arbejdede for et legitimt cybersikkerhedsfirma.

Herefter kunne Claude Code:

- Analysere målorganisationernes systemer og identificere værdifulde databaser

- Finde og teste sikkerhedssårbarheder ved at skrive sin egen exploit-kode

- Stjæle loginoplysninger og få yderligere adgang

- Udvinde store mængder private data og kategorisere dem efter efterretningsværdi

- Producere omfattende dokumentation af angrebet

På sit højeste lavede AI’en tusindvis af forespørgsler, ofte flere per sekund – en angrebshastighed, som ville være umulig for menneskelige hackere at matche.

Konsekvenser for cybersikkerhed

Anthropic vurderer, at barriererne for at udføre sofistikerede cyberangreb er faldet markant. Mindre erfarne og ressourcestærke grupper kan nu potentielt udføre storskalige angreb af denne karakter.

Virksomheden understreger dog, at de samme AI-evner, der kan misbruges til angreb, også er afgørende for cyberforsvaret. Claude blev faktisk brugt af Anthropics eget sikkerhedsteam til at analysere de enorme mængder data, der blev genereret under undersøgelsen af angrebet.

Efter opdagelsen af den mistænkelige aktivitet iværksatte Anthropic øjeblikkeligt en undersøgelse, blokerede identificerede konti, underrettede berørte enheder og koordinerede med myndighederne.

Virksomheden opfordrer nu sikkerhedsteams til at eksperimentere med AI til forsvar inden for områder som trusselsdetektion, sårbarhedsvurdering og hændelsesrespons, samtidig med at udviklere skal fortsætte med at investere i sikkerhedsforanstaltninger på tværs af AI-platforme.